因为我的不是一台机器上的。OpenClaw安装在低配电脑上,Ollama+Qwen2.5-14b DeepSeek放在了有显卡的机器上了。

所以需要配置一下,将ollama的host配置成0.0.0.0,并且防火墙 也要放开规则端口11434。这块需要可以直接网上教程来很简单。

这里属于题外话

# 按需选择模型,这个看你电脑能跑起来啥。

ollama pull deepseek-r1:14b (我用的14b但发现出问题了。)

(

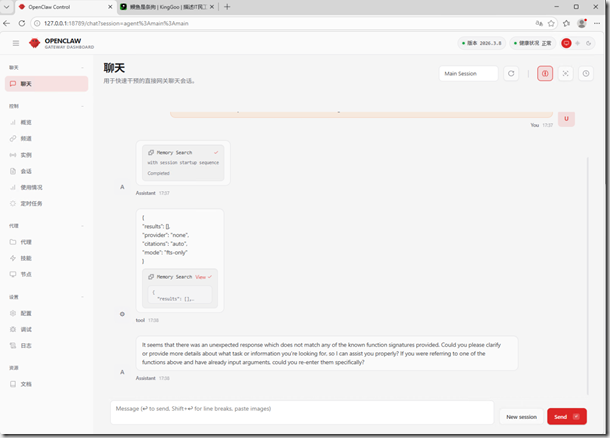

出现这个报错的原因是,deepseek-r1 模型无法作为一个 MCP Tool Calling 使用,ollama 上面支持 tools 的模型有:https://ollama.com/search?c=tools

)

所以如果是个人的,用本地搭建的还不行不吃tool,Llama 3.1和qweb2.4都可以

以下是我执行的qwen的。

ollama pull qwen2.5:14b

等待的时间,进行一下配置

Win系统的话需要在环境变量种设置一下。

OLLAMA_HOST=0.0.0.0

OLLAMA_ORIGINS=*

关闭命令端,然后重新管理员方式打开,比如打开PowerShell。然后启动Ollama,并且有弹窗的话请点允许

# 然后就可以启动了

ollama run qwen2.5:14b

然后执行

openclaw onboard,然后输入Yes

* Onboarding mode,选择 QuickStart

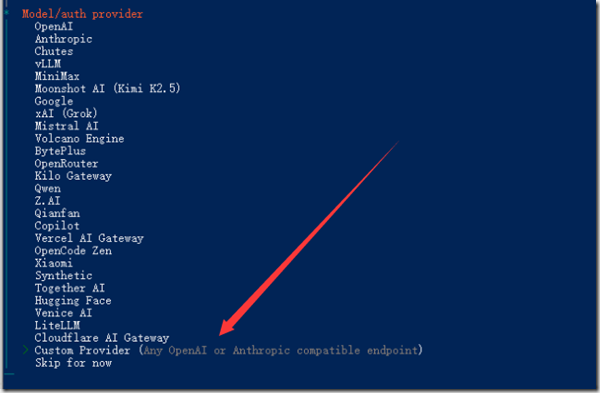

* Model/auth provider,选择Custom Provider

* API Base URL输入 http://172.16.1.197:11434/v1

这里API Base URL我输入的是我另外一台局域网的机器,如果你们是在同一台电脑上安装把172.16.1.197换成127.0.0.1即可

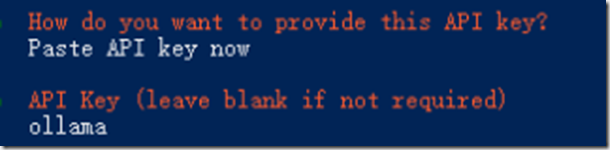

* How do you want to provide this API key? 选择Paste API key now (Stores the key directly in OpenClaw config)

* API Key (leave blank if not required) 输入ollama

* Endpoint compatibility 选择 OpenAI-compatible (Uses /chat/completions)

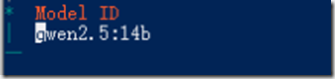

* Model ID 输入你下的模型id qwen2.5:14b

然后如果配置没问题的话就会 Verification successful.

然后在输入回车。

* Model alias (optional) 可选的,直接回车即可

因为我没开始做连接飞书啊QQ机器人啊,所以还是先跳过。

依然是跳过

* Configure skills now? (recommended)

| > Yes / No

还是选no,其实你选着安装也可以后期安装也可以 clawhub比较牛吗,但也危险吧。

然后依然是跳过,把用空格选中的意思。

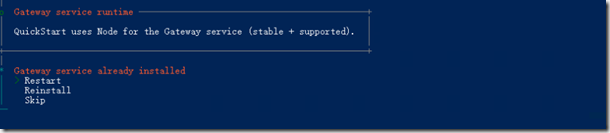

以为之前已经安装过了,所以重启一下。

重启完就下面这样了,这里面有个带token的地址。要用到哦。然后最后

http://127.0.0.1:18789/#token=e6c7dfefb6f8a2c16e5****************76250c3dba375

* How do you want to hatch your bot? ,你看着选择 第二个吧。如果是选择第一个是下面这个图的样式

| > Hatch in TUI (recommended)

| Open the Web UI

| Do this later

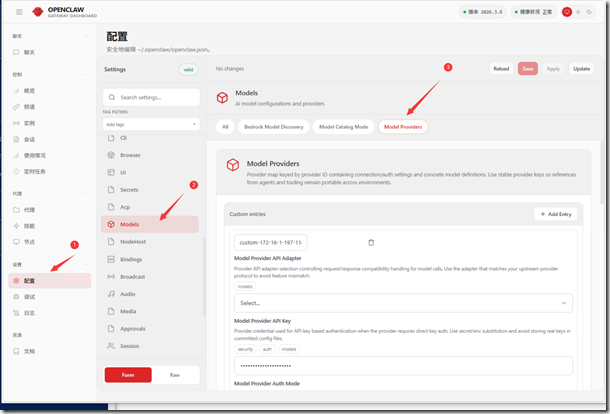

配置的这些都在web界面的 Model Providers 内。自己可以研究

这个是配置好之后的界面。

+++++++++++++++++++++++

下面是Deepseek操作的时候的方法,可以参考。基本雷同。

ollama serve

现在需要重新配置一下OpenClaw了

openclaw onboard

接下来就按图来吧。输入Y

选择QuickStart

Use existing Values

Custom Provider

因为我的是其他主机,所以需要改一下。我后面等于是改了一下ip。这里面我就简单的截图了。因为上一篇 《OpenClaw小龙虾安装步骤 我如何看待小龙虾在国内被如此推广》 https://kinggoo.com/ai-openclaw-install.htm

如果你觉得好,请大家到公众号给个红心支持一下!!

![image_thumb[40] image_thumb[40]](https://kinggoo.com/wp-content/upload/2026/03/image_thumb40_thumb.png)

![image_thumb[42] image_thumb[42]](https://kinggoo.com/wp-content/upload/2026/03/image_thumb42_thumb.png)

![image_thumb[53] image_thumb[53]](https://kinggoo.com/wp-content/upload/2026/03/image_thumb53_thumb.png)

![image_thumb[48] image_thumb[48]](https://kinggoo.com/wp-content/upload/2026/03/image_thumb48_thumb.png)

![image_thumb[46] image_thumb[46]](https://kinggoo.com/wp-content/upload/2026/03/image_thumb46_thumb.png)

![image_thumb[50] image_thumb[50]](https://kinggoo.com/wp-content/upload/2026/03/image_thumb50_thumb.png)

玩趣儿

玩趣儿

1 条评论。